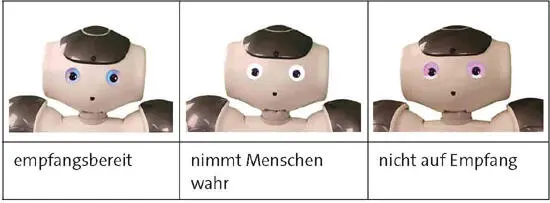

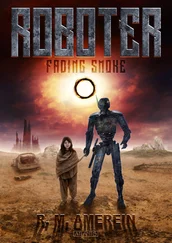

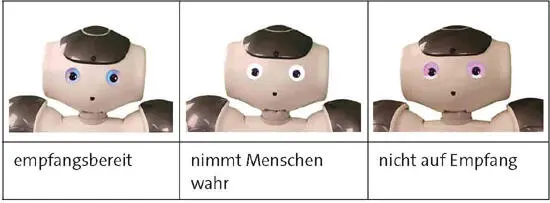

Herzstück für die Kommunikation mit Menschen sind NAOs vier Mikrofone und seine zwei Lautsprecher. Die Kommunikation kann jedoch auch über haptische Eindrücke eingeleitet werden, welche NAO über insgesamt 11 Tastsensoren, wahrnimmt. Diese befinden sich am Kopf, an den Händen und den Füßen. Zwei Ultraschallsensoren helfen NAO außerdem, seine Umgebung abzusuchen und mögliche Hindernisse zu erkennen. Visuelle Eindrücke nimmt NAO über zwei Kameras wahr, die sich nicht in seinen Augen, sondern auf Mund- und Stirnhöhe befinden. An der Stelle seiner Augen befinden sich dafür mehrere LEDs,10 die durch ihre Farbgebung dem menschlichen Gegenüber signalisieren, ob NAO aufnahmefähig ist, etwas verstanden hat, oder ob etwa eine Fehlermeldung aufgetreten ist. Abb. I.19stellt die für NAO.V6 Roboter werkseitig eingestellten ‚Kommunikationsfarben‘ dar.11

Abb. I.19: Die Kommunikationsfarben von NAO.V6

Von NAO wurden seit seiner Markteinführung immer wieder überarbeitete Versionen mit verschiedenen Prozessoren, Kameras sowie Freiheitsgeraden entwickelt. Die neueste Version ist NAO.V6. Sie erschien 2018 auf dem Markt und unterscheidet sich von den Vorgängermodellen durch einen stärkeren Akku, eine bessere Rechenleistung und hochwertigere Kameras. Außerdem arbeitet NAO.V6, genau wie sein großer Bruder Pepper, mit einer höheren Version des Betriebssystems NAOqi 2.8 (NAO.V6) bzw. NAOqi 2.9 (Pepper).

Frühere NAO-Versionen, z.B. NAO.V3, unterscheiden sich abgesehen von der äußeren Körperfarbe kaum von den neuen Modellen. Lediglich die zu Grunde liegenden NAOqi-Versionen haben sich verändert.

NAOs große Popularität ist zu einem großen Teil der Tatsache geschuldet, dass er sowohl leicht mit einer visuellen Programmierumgebung entwickelt, zugleich aber auch uneingeschränkt durch verschiedene Programmiersprachen programmiert werden kann. Die visuelle Programmierung Choregraphe, die nach einem Baukastensystem aufgebaut ist, hat sich auch für Neulinge der Robotik und des Programmierens als guter Einstieg bewiesen und bietet gleichzeitig für Fortgeschrittene die Möglichkeit, erste Schritte in der Programmierung des Roboters mit Python zu gehen (siehe Abschnitt V.4.1).

Abb. I.20: Schnappschuss vom RoboCup 2016

Neben der visuellen Programmierung über Choregraphe lässt sich NAO auch frei über die Programmiersprachen C++, Python und Java programmieren. Die Teilnehmer des RoboCups arbeiten beispielsweise mit C++, was die Möglichkeiten des Roboters allumfänglich ausschöpft, dem Programm jedoch auch eine enorme Komplexität verschafft.

Neben zahlreichen Forschungsprojekten und dem Einsatz in speziellen Labor-Settings an Universitäten wird NAO auch in den Bereichen Gesundheit und sogar im Kundenservice eingesetzt. In der Bildung allerdings beziehen sich die meisten Einsatzmöglichkeiten auf die Verwendung von NAO-Robotern als Werkzeug zur Erlangung bzw. Verbesserung des algorithmischen Denkens von Schülern und Studenten.

Eine besondere Form dieser Werkzeugnutzung ist der RoboCup. Seit 2007 nehmen zahlreiche, vorwiegend universitäre, Teams an dieser ‚Roboter-Fußballweltmeisterschaft‘ teil, nicht etwa um zu zeigen, wie gut Roboter Fußball spielen können, sondern um ihre höchst anspruchsvollen Programme auf den Prüfstand zu stellen.

I.3.1.2 Pepper

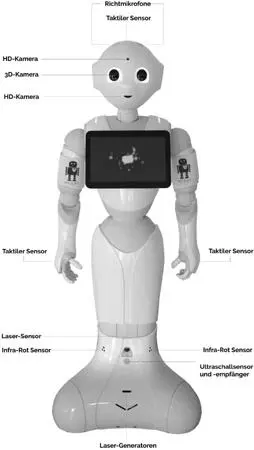

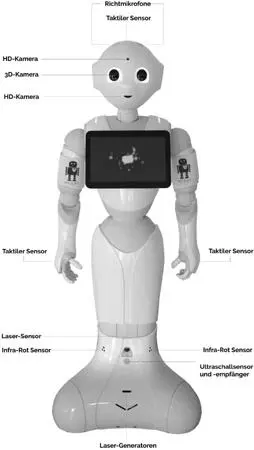

Pepper kann mit seinen 1,20 m Körpergröße als ‚großer Bruder‘ von NAO betrachtet werden. Er wurde ebenfalls von der Firma SoftBank Robotics entwickelt und nutzt, zumindest für alle Modelle, die vor 2019 hergestellt wurden, die von NAO bekannte Entwicklungsumgebung Choregraphe. Seit 2019 werden zusätzlich Pepper-Modelle ausgeliefert, die per Android/Java programmiert werden. Abb. I.21stellt Pepper mit seinen wesentlichen Komponenten dar.

Rein äußerlich sieht man, abgesehen von einer permanent sichtbaren Anzeige der identifizierten Benutzer-Spracheingabe über eine „Speech Bar“ auf dem Tablet und der Nutzung der Schulter-LEDs anstelle der Augen-LEDs bei Pepper-Modellen unter Android keine gravierenden Unterschiede zwischen diesem und früheren Pepper-Modellen.

Abb. I.21: Pepper und seine Komponenten

Pepper ist räumlich ziemlich flexibel einsetzbar. Dies gilt jedoch primär für das Innere von Gebäuden. Außeneinsätze sind dagegen problematisch wegen Peppers Empfindlichkeit gegenüber Umwelteinflüssen (z.B. Feuchtigkeit, Temperaturschwankungen, Untergrundbeschaffenheit). Außerdem kann die sensorische Wahrnehmung des Roboters durch Umgebungsfaktoren, wie z.B. Gegenlicht oder irritierende Objekte, stark beeinträchtigt werden. (Die letztgenannte Einschränkung gilt übrigens auch für den Einsatz im Inneren von Gebäuden.)

Pepper im HR-Fernsehen

In seiner ersten Live-Sendung „Hallo Hessen“ im Januar 2017 war Pepper bis wenige Minuten vor Sendungsbeginn extrem abgelenkt, schaute nur in Richtung Studiodecke und wollte partout, auch nach An- und Abschalten von ausgewählten Studiolampen, keinen Kontakt mit seinen Gesprächspartnern herstellen.

Kurz vor Beginn der Sendung konnte das Problem gelöst werden: Eine ballförmige weiße Schlafzimmerlampe hatte Pepper mit einem menschlichen Gesicht verwechselt. Nach Demontage der Lampe wandte sich der Roboter doch noch rechtzeitig seinen menschlichen Gesprächspartnern zu.

Pepper kann durch eigenständige Erkundung und Kartierung seine Umgebung kennenlernen und die resultierende Karte für die Navigation durch diese Umgebung nutzen.

Er ist mit zwei Armen und Händen mit jeweils fünf Fingern ausgestattet. Damit kann er kleine Objekte greifen, anheben, mit seiner Hand drehen und an einem anderen Ort ablegen. Allerdings sollten diese Objekte nicht schwerer als 500 Gramm sein, und die Manipulation von Objekten ist auch nicht sonderlich präzise. Das Schleppen von Lasten ist Pepper definitiv nicht möglich. In erster Linie haben Peppers Arme und Hände Kommunikationsfunktion, sie sind keine Werkzeuge für die Verrichtung manueller Arbeiten, sondern sie dienen primär der Unterstützung von Sprache durch Gesten.

Der Hauptzweck von Pepper und somit seine primäre Kompetenz ist die Interaktion mit Menschen. Neben der natürlichsprachlichen Dialogfähigkeit in mehreren Sprachen ist die Fähigkeit, Emotionen von Menschen zu erkennen und eigene Emotionen auszudrücken, ein weiteres herausragendes Merkmal von Pepper.

Seine sprachlichen Darbietungen können, abhängig von der Programmierung der Applikation, bimodal sein, indem Pepper seine gesprochenen Beiträge durch non-verbales Kommunikationsverhalten, insbesondere Gesten, komplementiert. Ein menschliches Niveau der verbalen und non-verbalen Kommunikationskompetenz sollte jedoch nicht erwartet werden, insbesondere nicht hinsichtlich Flexibilität und Robustheit.

Gesprochene Spracheingaben und -ausgaben lassen sich in Dialogen zwischen Mensch und Roboter einsetzen. In diesen Dialogen reagiert Pepper auf erkannte gesprochene Stimuli mit entsprechenden vordefinierten Antworten, die zufällig variiert werden können. Struktur und Thema des Dialogs, die möglichen Benutzereingaben und die möglichen Antworten des Roboters werden vom Entwickler vorgegeben.

Vorgefertigte Dialoge mit Pepper und NAO

Mensch: „Wie geht es Dir?“

Pepper: ^rand[gut super „sehr gut“ Klasse] und Dir?

Читать дальше