I.2.2.2 Die Dialogfähigkeit

[V.I.5]

Wenn wir uns unterhalten, produzieren wir Laute, die ein Gesprächspartner erkennt und diesen auch zur Produktion von Lauten als Antwort animiert. Jedes Mal, wenn wir einen Dialog führen, analysieren wir unseren Gesprächspartner körperlich sowie sprachlich und passen unsere Antworten entsprechend spontan an. Zum Beispiel kann die Frage „Wieso hast du das gemacht?” in verschiedenen Situationen anders verstanden werden, z.B. dass eine Person verärgert oder überrascht ist. Diese Informationen werden im Gehirn zu Antworten verarbeitet.

Humanoide Roboter haben weder entsprechende Organe, noch können sie Laute als Wörter erkennen und diese entsprechend verarbeiten. Sie erkennen gesprochene Sprache durch ein Speech Recognition System (dt. Spracherkennungssystem). Dazu werden Geräusche über die Mikrofone aufgenommen und mit den im System gespeicherten Informationen abgeglichen, um eventuelle Stichworte zu erkennen, die wiederum als Befehl zur Ausführung einer bestimmten Handlung bzw. Reaktion wahrgenommen werden. Über die Mikrofone und Lautsprecher können sie sich ‚mitteilen‘, ihrem Gesprächspartner Informationen geben oder sich mit ihnen unterhalten.

I.2.2.3 Mehrsprachigkeit

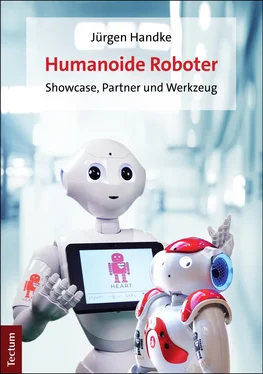

Zwar haben humanoide Roboter nicht die angebliche Sprachfähigkeit des nebenstehend gezeigten C3PO-Roboters aus den Star Wars Filmen,8 allerdings lassen sich schon heute auf einigen Robotern mehrere Sprachpakete installieren und bei Bedarf aktivieren. So lassen sich auf den SoftBank-Robotern NAO und Pepper mehr als ein Dutzend Sprachen installieren, wovon allerdings nur maximal vier gleichzeitig genutzt werden können.

Vorsicht bei unbekannten Wörtern

Ein generelles Problem für die Sprachsynthese, sowohl bei Maschinen als auch beim Menschen ist die Aussprache unbekannter Wörter, die sich nicht ohne Weiteres in eine Fremdsprache übersetzen lassen. Das gilt insbesondere für Namen. So werden deutsche Namen wie „Sabine“ auf Englisch zumeist falsch ausgesprochen:

*/sə‘bi:n/ statt /za’bi:nə/.

Dass man sich diesen Effekt im Aussprachetraining allerdings auch zunutze machen kann, zeigen wir in Abschnitt V.5.4.1.

I.2.2.4 Das Varietäten Problem

Probleme kann es bei der Spracherkennung von Dialekten geben. Selbst Menschen, die die gleiche Sprache sprechen, geraten hin und wieder in Situationen, in denen sie das Gegenüber aufgrund ihres Dialekts nur schwer oder gar nicht verstehen, oder es kommt auf diese Weise zu Missverständnissen. Humanoide Roboter haben ein sprachspezifisches ‚Klangmuster‘ einprogrammiert, vergleichbar mit einer Vorlage davon, welche Laute in einer Sprache vorkommen, wie diese im Idealfall klingen, und in welcher Verbindung miteinander diese auftreten können. Die vernommenen Klänge vergleichen sie mit diesem Muster und können die auditiven Informationen darauf basierend einordnen bzw. verstehen. Weicht ein Input zu weit von diesem Muster ab, kann der Roboter die Klänge nicht mehr genau zuordnen und versteht den Menschen falsch oder gar nicht.

I.2.2.5 Gefühle

[V.I.6]

Kurz gesagt: humanoide Roboter können nicht fühlen wie Menschen. Sie sind aber in der Lage, menschliche Emotionen nachzuahmen bzw. vorzutäuschen. Wenn ein Mensch beispielsweise „Mir geht es heute gar nicht gut“ sagt, kann ein Roboter durchaus mitfühlend seufzen und folgende Antwort geben: „Das tut mir Leid! Ich hoffe sehr, dass es dir bald wieder besser geht“.

Tatsächlich fühlt der Roboter aber nicht mit dem Menschen mit, sondern er reagiert lediglich auf einen vorprogrammierten Impuls mit einer vorprogrammierten Antwort. In seinem Programm kann z.B. definiert sein, dass er, wenn er den Satz „Mir geht es heute gar nicht gut“ oder einen sinngemäß ähnlichen Satz hört, die oben beschriebene Reaktion ausführen soll.

I.2.2.6 Bewegung

[V.I.7]

Welche Bewegungen ein humanoider Roboter ausführen kann, ist abhängig von seinem Aufbau und somit von Modell zu Modell verschieden. Da humanoide Roboter nicht nur ein menschenähnliches Aussehen, sondern auch ein vergleichbares Verhalten haben sollen, können viele von ihnen ihren Kopf, ihre Arme oder auch die Beine bewegen. Oft sind diese auch mit flexiblen Gelenken ausgestattet, die eine genauere Nachahmung der menschlichen Bewegung zulassen. Einige können sogar feinere Bewegungen, sowie das Heben und Senken einzelner Finger, das Bewegen der Augen oder das Öffnen und Schließen eines Mundes durchführen.

In ihrer Fortbewegungsmöglichkeit sind humanoide Roboter oftmals noch relativ eingeschränkt, u.a. wegen ihrer begrenzten Akkukapazität. Während die Erkennung von Objekten und deren Umgehung relativ problemlos funktioniert, gestaltet sich die Überwindung oder gar Beseitigung nicht umgehbarer Hindernisse häufig als problematisch. Ebenso stellt das Heben von Gegenständen wie z.B. eines Kugelschreibers, und die anschließende Nutzung desselben, für viele Roboter derzeit eine schwierige Aufgabe dar.

[V.I.8]

NAO und der RoboCup

Durch seine vielen Gelenke besitzt der humanoide Roboter NAO die Fähigkeit, sich nahezu wie wir Menschen bewegen zu können. Er kann aufstehen, sich hinsetzten, laufen, aber auch hinfallen. Durch seinen integrierten ‚Fallschutz‘ versetzt er sich während eines Sturzes in eine Sicherheitspose und ‚verletzt‘ sich so meistens nicht. Dass NAO-Roboter ziemlich beweglich sind, kann man auch daran sehen, dass seit dem Jahr 2008 der RoboCup, also die Roboter Fußballweltmeisterschaften, mit diesem Modell ausgetragen werden.

I.2.2.7 Sensorik/Wahrnehmung

[V.I.9]

Roboter können ihre Umgebung über Sensoren mit unterschiedlichen Funktionen wahrnehmen. Während Kameras als ‚Augen‘ dienen und visuelle Signale einfangen, übernehmen Mikrofone die Wahrnehmung von Geräuschen und Klängen und fungieren somit als ‚Ohren‘ eines Roboters. Wie viele Augen und Ohren ein Roboter hat, kann stark variieren und hängt von seinem vorgesehenen Einsatzgebiet ab. In beiden Schnittstellen zur Umgebung („Eingabe“ und „Ausgabe“) treten fast zwangsläufig Mehrdeutigkeiten, Ungenauigkeiten und Verluste auf, die kompensiert werden müssen. In beiden Fällen besteht eine bewährte Vorgehensweise darin, mehrere Ein- bzw. Ausgabekanäle miteinander zu kombinieren. Auch aus diesem Grund sind gerade humanoide Roboter mit Sensoren und Aktuatoren ausgestattet, die mehrere Kanäle oder menschliche Sinne abdecken, wie z.B. Sehen, Hören und Tasten. Daneben stehen Robotern noch weitere nicht-menschliche Sinne zur Verfügung, darunter Sonar oder Laserabtastung.

I.2.2.8 Gefühle (Haptik)

Roboter können wie wir Menschen auch fühlen, d.h. sie merken wenn sie angefasst werden. In vielen Fällen werden hier einfache Drucksensoren benutzt. Diese registrieren Berührungen und lassen den Roboter in gewisser Weise seine Umgebung ‚spüren‘. Wie viele dieser Sensoren ein Roboter besitzt, oder ob der gesamte Körper damit überzogen ist, variiert zwischen Robotermodellen sowie deren Einsatzszenarien.

Читать дальше