4 Die Aufschlüsselung des Algorithmus

Du hast gerade viel über die Geschichte der Systeme gelernt, die YouTube seit dem Start zum Laufen gebracht haben, und du weißt, dass diese Systeme recht gut in dem geworden sind, was sie tun. Aber was bedeutet das im wahrsten Sinne des Wortes? Wenn du auf die Website gehst, wie sehen die Systeme dann aus, während du navigierst? Um diese grundlegenden Konzepte wirklich erfassen zu können, lass uns klarstellen, was tatsächlich geschieht, wenn jemand eine Seite besucht.

Sobald ein Besucher auf YouTube.comeintrifft, wird er verfolgt. Es ist wie damals, als du noch ein kleines Kind warst und deinen Freund besucht hast, um mit ihm zu spielen, aber sein kleiner lästiger Bruder euch einfach nicht allein ließ. Doch sieh es einmal so: Anstatt lästig zu sein, beobachtet der Bruder still euer Verhalten und liest euch jeden Wunsch von den Augen ab. Ihr möchtet einen Snack. Schon läuft er in die Küche und kehrt mit einem Apfel zurück. Ihr sagt: »Nein, danke.« Also bringt er den Apfel zurück und kommt mit einer Tüte Chips zurück. Ihr esst die Chips. Dann sprecht ihr über Han Solo. Also läuft er ins Wohnzimmer und spielt für euch Das Imperium schlägt zurück . Wenn du deinen Freund das nächste Mal besuchst, überreicht er dir schon beim Betreten des Hauses einen Keks und schaltet Die Rückkehr der Jedi-Ritter ein. Seine Vorhersage, was du essen oder sehen wollen könntest, basiert auf deinem letzten Besuch und ist wahrscheinlich ein Volltreffer. Oh, und außerdem wirst du bei dieser Behandlung wahrscheinlich häufiger dort zu Besuch sein wollen. Sie wissen, was dir gefällt. (Es sei denn, er schlägt dir Die letzten Jedi oder Solo vor. In diesem Fall gehst du nächstes Mal einfach zu den Zuckerbergs, weil diese Filme Mist sind.)

Sagen wir, anstelle von Chips hättest du lieber Karottenstifte und anstelle von Star Wars möchtest du lieber Wiederholungen von The Office sehen. Bei deinem nächsten Besuch würde dir der kleine Bruder Brokkoli und Parks and Recreation anbieten. Das Konzept funktioniert unabhängig von deinen Vorlieben.

Mit folgenden Beispielen kann man YouTubes Ziele erklären:

Voraussagen, was der Viewer schauen wird.

Langfristiges Engagement und Zufriedenheit des Viewers maximieren.

Wie sie dies erreichen, lässt sich in zwei Teile herunterbrechen: Sammeln und Nutzen von Daten und Algorithmen mit einem »S«.

Teil 1: Sammeln und Nutzen von Daten

YouTube sammelt jeden Tag 80 Milliarden Datenpunkte aus dem Nutzerverhalten. Sie sammeln Daten in zwei Kernbereichen, um die Ziele der KI zu erreichen. Der erste beobachtete Bereich ist das Nutzerverhalten per Metadaten. Aufgrund des Verhaltens der Person, deren Augen auf den Bildschirm gerichtet sind und deren Finger das Klicken übernehmen, werden Dinge über ein Video ermittelt. Durch »Zufriedenheitssignale« trainiert die KI, was vorgeschlagen werden soll und was nicht. Es gibt eine ganz spezielle Liste dieser Signale:

Welche Videos schaut der Betrachter?

Welche Videos überspringt er?

Wie viel Zeit verbringt er mit Schauen?

Likes und Dislikes.

»Kein Interesse«-Feedback.

Umfragen nach Anschauen eines Videos.

Ob er zurückkehrt und sich etwas erneut anschaut oder etwas zu Ende schaut, das er noch nicht ganz gesehen hat.

Ob er es speichert und es sich später ansieht.

All diese Signale speisen die Zufriedenheits-Feedback-Schleife. Diese Schleife wird auf der Grundlage des Feedbacks erstellt, das der Algorithmus durch dein spezielles Verhalten erhält. Er »schleift« die Arten von Videos, die dir gefallen, durch die Vorschläge. So wird das Erlebnis jedes einzelnen Nutzers personalisiert.

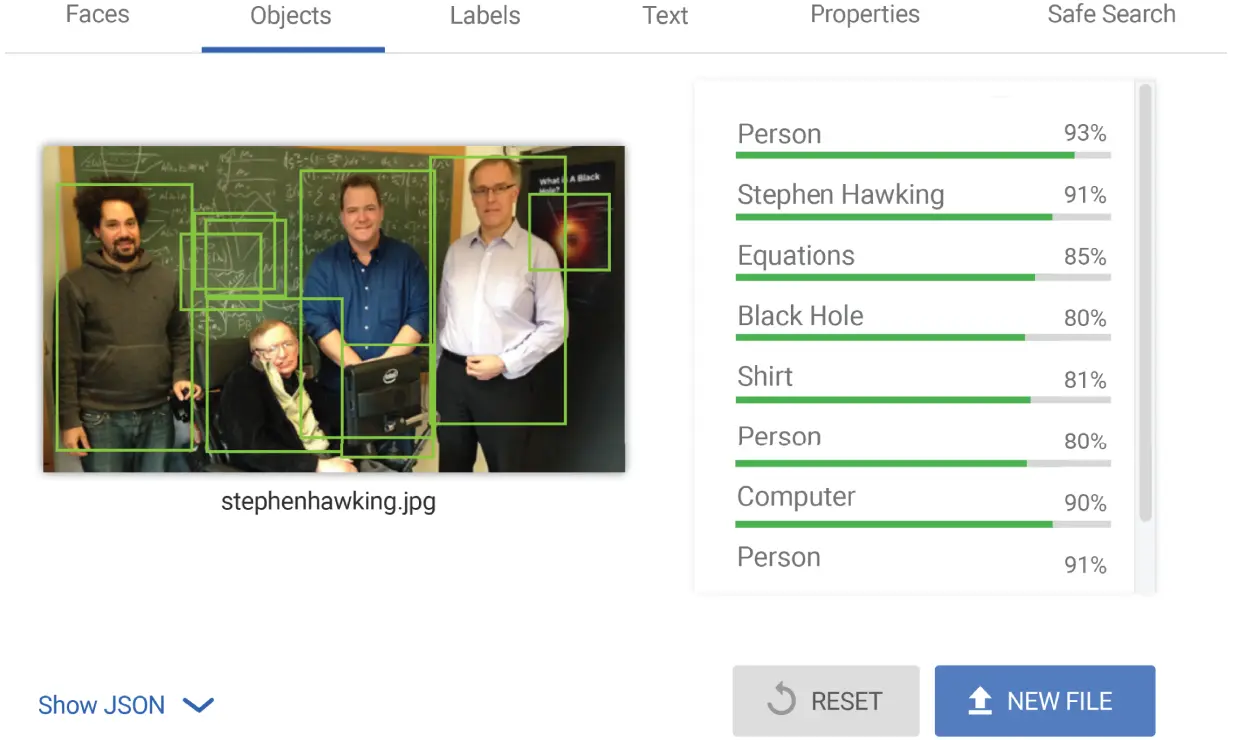

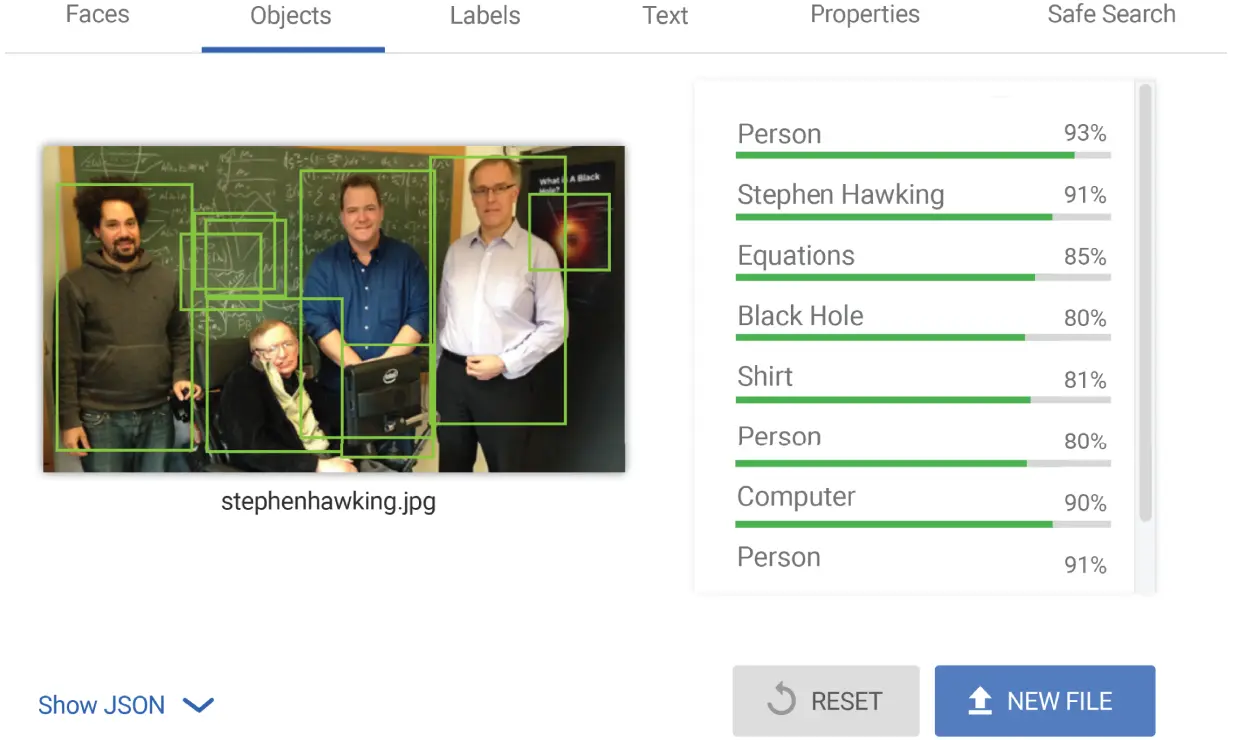

Damit wir die Einzelheiten in Angriff nehmen können, folgt hier eine Erklärung, wie genau die KI Daten sammelt. Die Beobachtung der Metadaten beginnt mit dem Thumbnail (Vorschaubild). Die YouTube-KI verwendet die hochentwickelte Technik von Googles Reihe von KI-Produkten. Sie bedient sich eines Programms namens Cloud Vision (CV). CV nutzt optische Zeichenerkennung (Optical Character Recognition, kurz: OCR) und Bilderkennung (Image Recognition), um viele Dinge über ein Video aufgrund dessen festzustellen, was sie im Thumbnail findet. Sie nimmt Punkte aus jedem einzelnen Bild im Thumbnail, erkennt diese Bilder mittels Milliarden von bereits im System gespeicherten Datenpunkten und füttert den Algorithmus dann wieder mit diesen Informationen. Wird beispielsweise ein Thumbnail mit einer Nahaufnahme des Gesichts des weltberühmten Physikers Stephen Hawking als solche in CV erkannt, kann das Video in dem Vorschlagsfeed zusammen mit jedem anderen Video auf YouTube »gruppiert« werden, das mit dem Thema Stephen Hawking verschlagwortet ist. Auf diese Weise werden deine Videos gefunden und gesehen.

Des Weiteren nutzt CV ein »Sicherheits-Tool«, das aufgrund der aus den Bildern in deinem Thumbnail gesammelten Daten feststellt, ob dein Video für alle Zielgruppen geeignet ist oder ob es »Erwachsenenthemen«, Gewalt oder andere fragwürdige Inhalte zum Gegenstand hat, und gibt ihm einen »Zuverlässigkeitswert« entsprechend dieser Feststellung. Dieser Wert gibt außerdem an, wie genau der Content dem gezeigten Thumbnail entspricht. Das heißt, du kannst ein Thumbnail gestalten, mit Cloud Vision verbinden und schon, bevor du das Video vollständig hochgeladen hast, erfahren, wie das Thumbnail von dem System voraussichtlich bewertet werden wird. Die Verwendung von Cloud Vision kann helfen, etwas auszumachen, das – aus welchem Grund auch immer – an einem x-beliebigen Datenpunkt als unangemessen gekennzeichnet wird, und somit dem Creator die Gelegenheit geben, das Problem zu beheben, noch bevor das Video online ist. Das hat die Demonetarisierung und andere Probleme, mit denen Creators in der Vergangenheit zu kämpfen hatten, reduziert. Es kann ein sehr wertvolles Instrument sein und dir helfen, den Problemen immer einen Schritt voraus zu sein. CV ist keine exakte Kopie von YouTubes Sicherheitsmaßnahmen, kommt diesen aber nahe genug, dass die Creators eine gute Vorstellung davon bekommen, wie der Content von YouTube definiert wird. CV toleriert möglicherweise etwas, das YouTube nicht toleriert, aber dennoch ist es ein hinreichendes Pre-Launch-Tool.

Abbildung 4.1:Thumbnail mit Datenpunkten

Nach Prüfung des Thumbnails geht die KI jeden einzelnen Rahmen des Videos durch und erstellt Sequenzprotokolle und Bezeichnungen aufgrund dessen, was sie in dem Content des Videos selbst sieht. Wenn du beispielsweise ein Video auf einem Parkplatz drehst, erkennt die KI die Ladenfront, Menschen, Blumen, Marken und noch mehr und kann diese Informationen dann für Empfehlungen protokollieren und dieselbe Sicherheitsroutine durchlaufen lassen, die sie nutzt, um Thumbnail-Bilder zu prüfen. Sei dir bewusst, was in dem Frame in jeder Szene in jedem Video, das du erstellst, zu sehen ist! Es wird von der KI erkannt und entsprechend sortiert, weil die KI das Thumbnail validiert. Die KI filtert die Informationen aus jedem kleinen Detail in jedem Frame und bestimmt, was für das Video und seine Metadaten am wichtigsten ist.

Dasselbe macht die KI mit der Sprache im Video. Heute bietet YouTube die Funktion der automatischen Untertitel und die KI liest die Wörter im Untertitel, um auch diese Daten zu sammeln. Das Durchgehen der Frames im Video anhand der Shot-Liste ist also im Grunde wie ein Blick auf das, was visuell gesagt wird, während das Anhören des Tons noch mehr Rückmeldung darüber gibt, was tatsächlich verbalisiert wird. Alles fließt in das System.

Читать дальше