Практически каждый хостинг автоматически сохраняет копию сайта в определенный период. Чем мне нравится http://www.red-nuts.com/reg 13

Но и этот метод использую, на случай, если на компе все вдруг тю-тю. В общем, я как тот чукча из анекдота с двумя билетами и проездным))) В таком деле, да еще когда у тебя материалов огромное количество за пару лет скопилось на сайте – лучше перебдеть, чем недобдеть, на мой взгляд =)

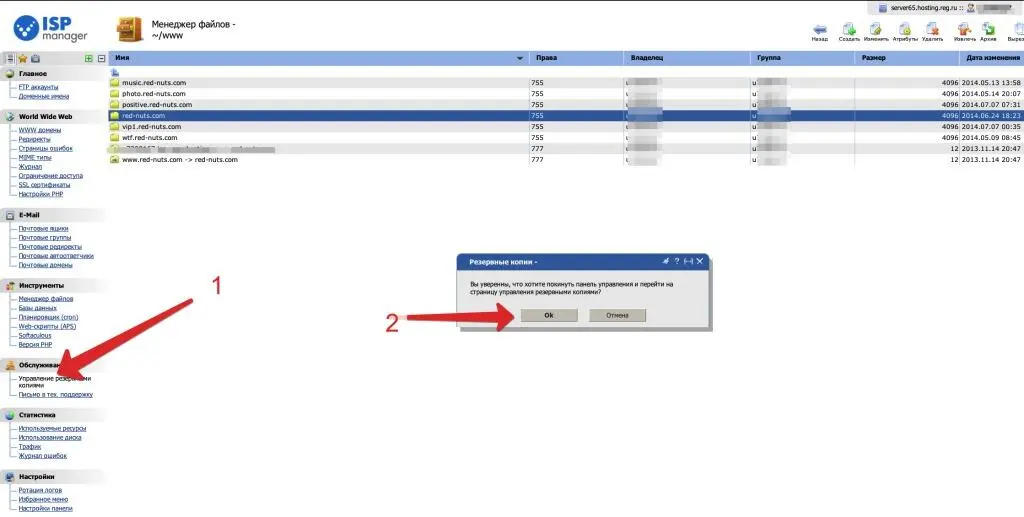

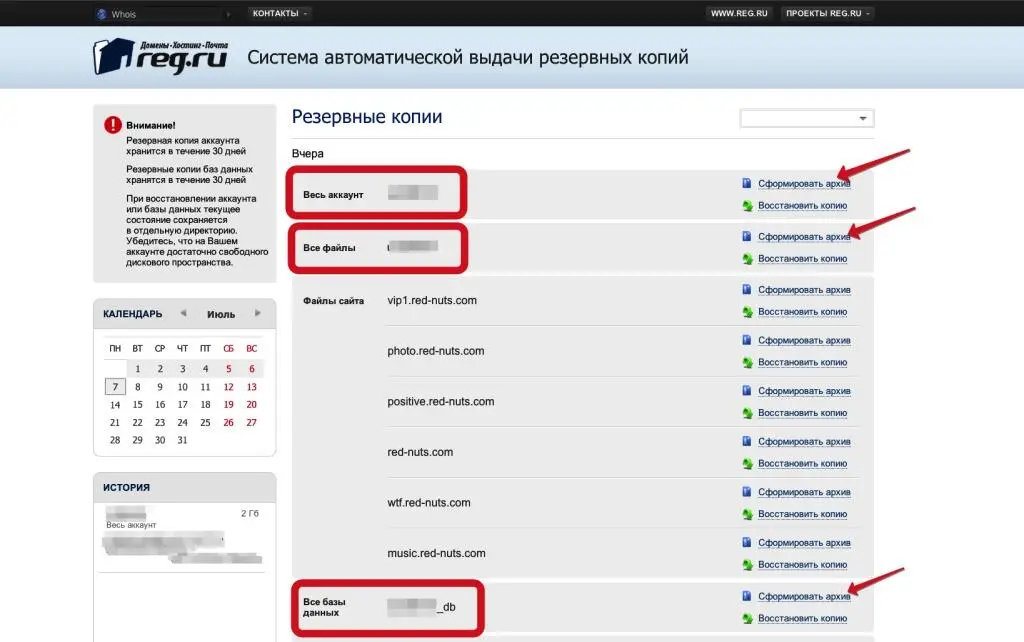

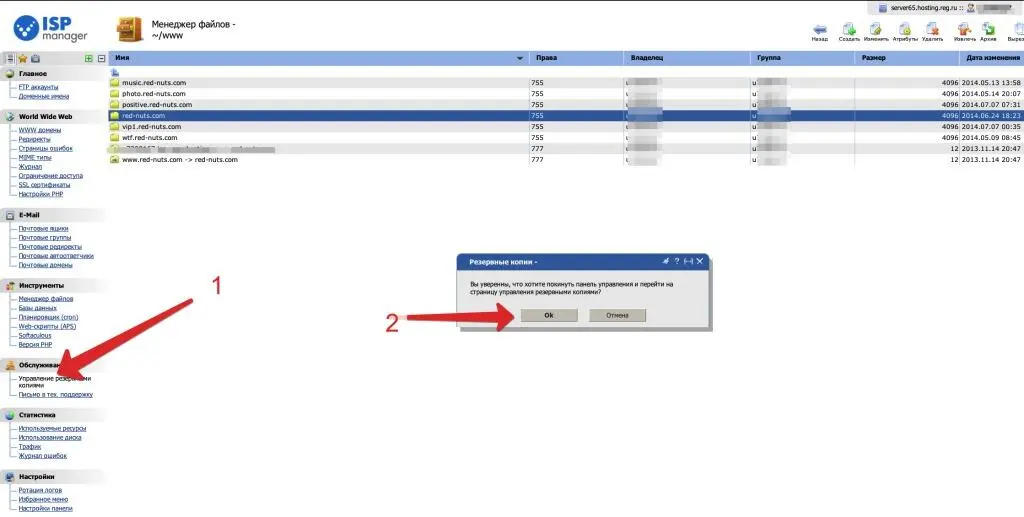

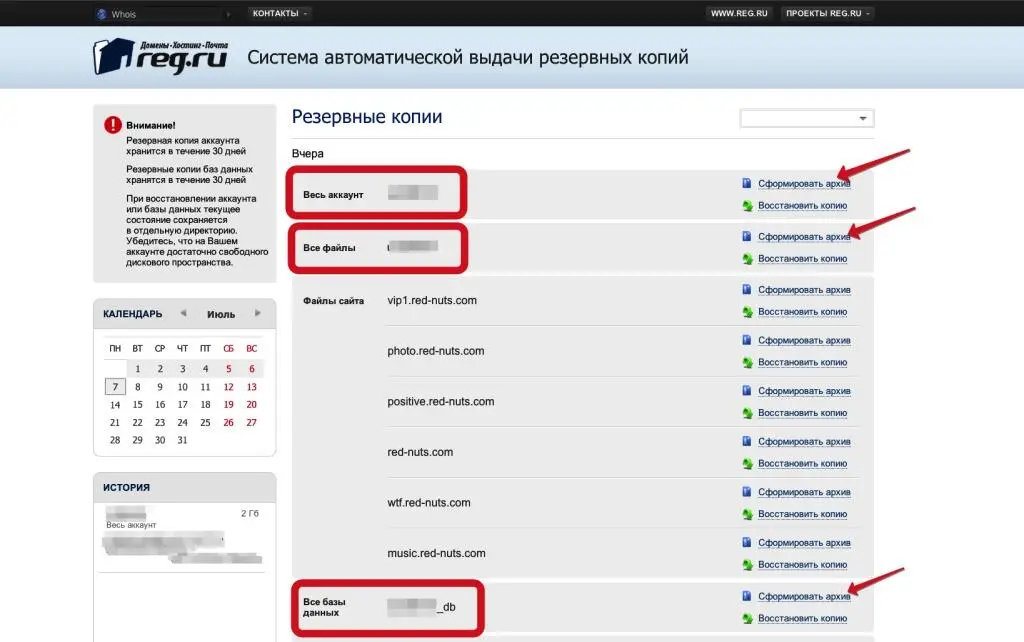

Второй способ еще проще – ничего никуда скачивать не нужно – все есть на сервере хостера. Заходите и формируете копию и скачиваете или сразу востанавливаете с нужной даты. Смотрите скриншоты =)

Как видите, все довольно просто и занимает немного времени, зато данная процедура при регулярном пользовании может сэкономит вам кучу времени и нервов в случае какого либо сбоя в системе.

Продолжаем настраивать наш сайт!

Для того, чтобы ваш сайт правильно индексировался и поисковые системы брали только нужную информацию (ну к примеру зачем им ваши данные админки или служебных файлов? – я тоже думаю ни к чему) необходимо создать файл robots. txt и загрузить его в корневую папку сайта.

Как вы уже наверняка догадались файл является неким указателем или инструкцией для поисковых роботов. Словно карта, он указывает – куда ходить и что индексировать можно, а куда поисковым роботам ходить не нужно.

Сам файл не влияет на ранжирование (поисковую выдачу) сайта, поэтому многие принебрегают им и не запариваются с установкой вовсе. В какой то степени – не очень обдуманно, раскажу чуть подробнее.

Это достаточно мощный инструмент, с помощью которого можно, к примеру, вообще целиком запретить индексацию вашего интернет ресурса, можно частично, можно ограничить круг поисковиков и одним разрешить, другим запретить индексацию сайта или отдельных его страниц. Очень полезен данный инструмент также и во время реконструкции или переделки сайта, когда вы на время можете запретить индексацию.

Более того, файл роботс останавливает и некоторые виды спам роботов, которые сканируют сайт на предмет наличия и последующего сбора электронных адресов в целях последующего их использования для спама. Ну и конечно же, от поисковых машин с помощью этого инструмента можно также легко скрыть разделы сайта, предназначенные для определенного круга пользователей – то есть страницы «не для всех» с приватной и закрытой от общего доступа информацией.

О том, каким образом правильно сделать и настроить данный файл мы и поговорим кратко в данной публикации.

Вообще robots достаточно просто написать вручную без каких либо конструкторов, которых к слову по интернету море. Весь процесс сводится к прописыванию спецкоманд в обычном файле блокнота. Потом этот файл сохраняем под именем robots и закачиваем в корень нашего сайта. В итоге он должен быть у нас по адресу ваш-сайт.ru /robots. txt

Сам файл я подготовил для вас, поэтому изобретать велосипед вам не нужно – просто слова» «ваш-сайт.ru в этом файле нужно заменить на адрес вашего сайта (без www и http://). Взять готовый файл и залить к себе на сервер можете здесь: http://red-nuts.com/sitedj/robots.txt

Конечно, вы можете сами полностью сделать с нуля свой файл robots. txt, благо информации по этому вопросу в интернете навалом, я остановлюсь лишь на основных директивах, которые в нем используются и в двух словах объясню для чего они применяются.

Итак… Что нужно для создания правильного robots. txt

Обязательно должны присутствовать две директивы – User-agent и Disallow. User-agent – определяет для какого бота (от какой поисковой системы) предназначено послание, а функция Disallow запрещает индексировать ту или другую страницу.

Если вы хотите задать для всех ботов одни и теже правила – просто пропишите после функции User-agent символ звездочку. Если при этом нужно запретить (допустим) индексирование страницы ваш-сайт.ru /abc. html и полностью содержимое директории (папки) private, то ваш файл будет иметь такое содержание:

User-agent: *

Disallow: /abc. html

Disallow: /private/

В случае, если вам нужно разрешить полный доступ роботу, который индексирует сайт, ваш файл будет таким:

User-agent: *

Disallow:

Особенности robots. txt

Есть еще несколько особенностей и нюансов, но повторюсь – информации в интернете по этому вопросу (для желающих глубже изучить) достаточно много, поэтому не считаю необходимым подробно на ней останавливаться в рамках данного курса.

Читать дальше

Конец ознакомительного отрывка

Купить книгу